De jugar solo a jugar en equipo

Diario de Innovación #217

Durante mucho tiempo, trabajar con modelos de lenguaje era como jugar un partido de tenis.

Tú, una raqueta (el prompt), y una máquina al otro lado devolviendo la pelota.

Con algo de práctica aprendías a colocar bien las preguntas, ajustar el tono y dirigir la pelota al lugar correcto.

Eso era el prompt engineering: precisión, técnica y reflejos.

Pero la inteligencia artificial ya no juega sola.

Ha pasado del tenis al fútbol.

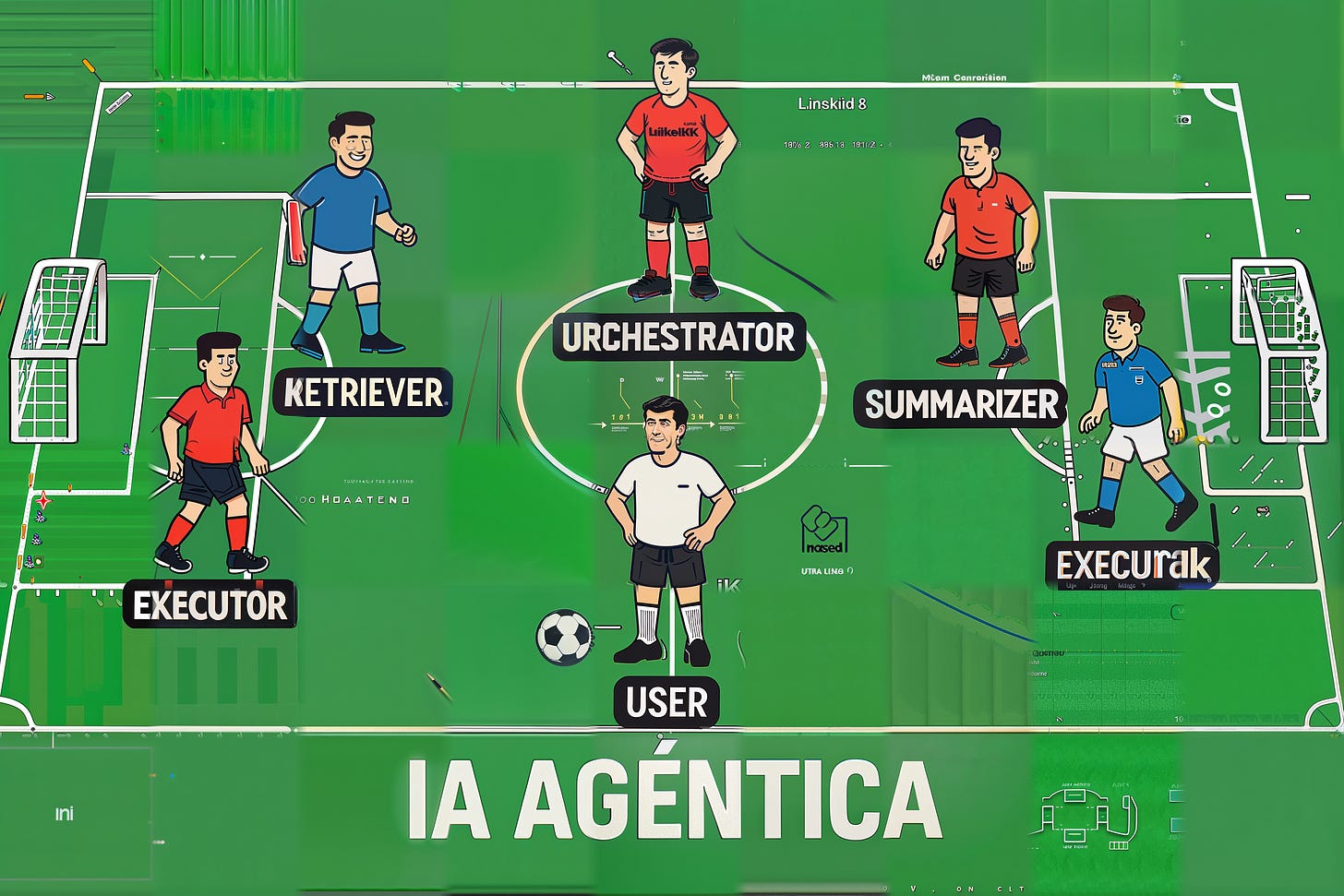

Hoy no hablamos de un modelo respondiendo a un usuario, sino de equipos de modelos (agentes) que colaboran entre sí:

uno interpreta, otro busca información, otro resume, otro ejecuta una acción.

Y como en todo deporte de equipo, la clave ya no está solo en la habilidad individual, sino en la coordinación, el contexto compartido y las reglas del juego.

Esa es la esencia del context engineering.

No se trata solo de decirle a un modelo qué hacer, sino de diseñar cómo todos los agentes comparten, recuerdan y entienden el entorno en el que operan.

El contexto es la pizarra táctica, el sistema de juego que mantiene a cada jugador en su posición y evita que la pelota (la información) se pierda en medio del campo.

Como en el fútbol, no existe una única forma de jugar.

Hay equipos que apuestan por la solidez defensiva, otros por la posesión, y algunos viven del contragolpe. Todo depende del rival, del marcador y del contexto.

En la ingeniería del contexto ocurre lo mismo: no hay una estrategia universal, sino tácticas que se adaptan al tipo de “partido” que tu agente debe jugar.

Dos estrategias de juego: trimming vs summarization.

El trimming sería como un 4-4-2 clásico: compacto, eficiente, sin florituras.

Recortas el contexto y te quedas con lo esencial, priorizando velocidad y orden.

Ideal para flujos operativos, tareas cortas y entornos donde cada jugada empieza de cero.

El summarization, en cambio, se parece más a un 3-4-3 ofensivo: más creativo, arriesgado y con visión de conjunto.

Conservas la memoria del partido —resúmenes, decisiones pasadas, contexto histórico— para mantener coherencia y continuidad.

Requiere más recursos, pero te permite jugar a largo plazo, con inteligencia táctica y visión global.

Y si hablamos de estrategias más cerradas, el catenaccio —esa muralla italiana que no deja pasar nada— sería el equivalente a sistemas donde el contexto se protege y filtra con precisión quirúrgica: nada entra si no aporta valor.

Cada enfoque tiene su lugar:

el trimming para partidos rápidos y resultados inmediatos,

el summarization para temporadas largas donde la memoria marca la diferencia,

y el catenaccio contextual cuando lo importante es la fiabilidad y la precisión.

Lo importante no es solo tener buenos jugadores (modelos), sino saber qué estrategia aplicar en cada partido.

Como explica Emre Okcular en su publicación sobre short-term memory management con el SDK de OpenAI Agents, hay dos formas principales de gestionar el contexto cuando los partidos se alargan:

Trimming — Recortar el historial y conservar solo los últimos turnos.

Ideal para flujos rápidos y predecibles.

Poca latencia, bajo coste, pero poca memoria: el equipo olvida jugadas pasadas.

Summarization — Resumir el contexto anterior y mantener una versión compacta de lo importante.

Permite continuidad y coherencia a largo plazo, a costa de algo más de latencia y complejidad.

Perfecto para proyectos con dependencia entre pasos, análisis prolongados o asistentes que necesitan “recordar”.

En el fondo, elegir entre una y otra depende del tipo de juego:

¿un sprint táctico o una liga de fondo donde cada partido influye en el siguiente?

Y cuando entran los datos vectorizados

El contexto ya no solo se construye con texto.

Los agentes pueden “recuperar memoria” a partir de bases vectoriales —sistemas basados en técnicas como el RAG (Retrieval Augmented Generation)— donde se almacenan fragmentos de conocimiento relevantes.

Cuando un agente necesita contexto, no busca en su cabeza: lo busca en la biblioteca vectorial.

Esta combinación permite que el equipo (de agentes) trabaje con una memoria dinámica y externa, integrando datos de negocio, documentación o historiales de usuario sin saturar la ventana de tokens.

En otras palabras: un entrenador de datos que le recuerda al equipo qué jugadas funcionan y cuáles no.

Del “yo pregunto, tú respondes” al “nos coordinamos para resolver”

El cambio más profundo no es técnico, sino conceptual.

El context engineering marca el paso de una interacción uno a uno —humano y modelo— a un sistema uno-a-muchos —humano y un equipo de agentes especializados—.

Diseñar cómo se reparten las tareas, cómo se pasa el contexto entre ellos y cómo se mantiene la coherencia global es el nuevo arte.

Porque un agente sin contexto puede ser brillante… pero descoordinado.

Y una IA sin contexto compartido es como un equipo con once Vinicius que no se pasan el balón.

En el fútbol como en la IA Generativa, el talento individual importa.

Pero lo que gana campeonatos es el contexto que los conecta.

Que nunca te falten ideas, ni ganas de probarlas.

A.

PD1: Si quieres saber como coger la ola de la IA Agéntica, no pierdas de vista este libro: Building Agentic AI Systems: Create intelligent, autonomous AI agents that can reason, plan, and adapt. Un recorrido por los principios de diseño detrás de sistemas multiagente, con ejemplos reales de coordinación, paso de contexto y gobernanza de IA.

PD2: Y si quieres quedarte un paso antes y profundiza en técnicas como el RAG, pipelines de contexto y estrategias para escalar aplicaciones con LLMs en entornos empresariales, desde copilotos hasta asistentes cognitivos. Este es tu libro: AI Engineering: Building Applications with Foundation Models.