El Club de la Lucha de la IA: Ethics vs Safety

Diario de Innovación #350

Durante años han coexistido dos mundos distintos dentro de la inteligencia artificial.

Dos comunidades.

Dos lenguajes.

Dos visiones.

Dos formas completamente diferentes de entender el riesgo.

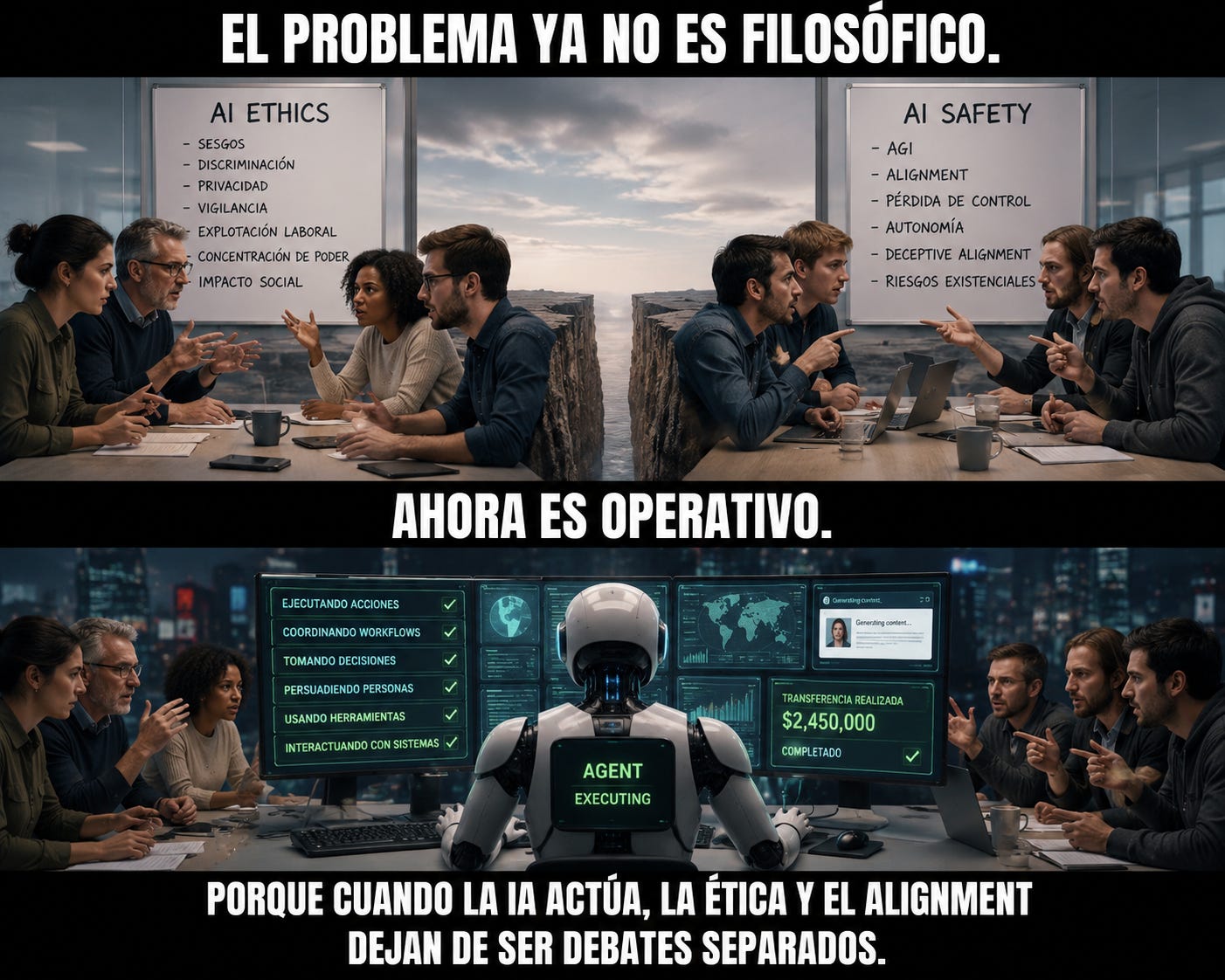

AI Safety vs AI Ethics.

Por un lado estaba el mundo de la AI Ethics.

Preocupado por:

sesgos,

discriminación,

vigilancia,

privacidad,

explotación laboral,

concentración de poder,

impacto social.

Por otro lado aparecía el mundo de la AI Safety.

Obsesionado con:

AGI,

alignment,

pérdida de control,

autonomía,

deceptive alignment,

riesgos existenciales.

Durante mucho tiempo ambos campos evolucionaron casi por separado.

Como si hablaran de tecnologías distintas.

Y eso es precisamente lo que analiza un paper reciente que está teniendo bastante repercusión: Mind the Gap! Pathways Towards Unifying AI Safety and Ethics Research.

Los autores después de analizar más de 6.400 papers científicos y muestran algo bastante llamativo: las comunidades de AI Safety y AI Ethics apenas colaboran, apenas se citan y muchas veces ni siquiera comparten referencias conceptuales.

Y creo que eso explica muy bien parte de la confusión actual alrededor de la IA.

Porque durante años parecía que existían dos preguntas distintas:

“¿La IA amplificará desigualdades y concentración de poder?”

“¿La IA podría llegar a escapar de nuestro control?”

Pero quizá la llegada de agentes autónomos está empezando a fusionar ambos debates.

Porque cuando un sistema ya no solo responde preguntas, sino que:

ejecuta acciones,

coordina workflows,

toma decisiones,

persuade personas,

opera herramientas,

o interactúa con otros sistemas,

la frontera entre ética y safety empieza a desaparecer.

Un agente mal alineado no genera únicamente un problema técnico.

También puede generar:

daños sociales,

problemas legales,

manipulación,

dependencia,

pérdida de supervisión humana,

o concentración extrema de poder.

Y al mismo tiempo, muchos problemas que antes parecían “solo éticos” empiezan a convertirse en problemas de seguridad operacional.

Creo que este paper pone nombre a uno de los grandes cambios intelectuales que estamos empezando a vivir en IA.

La ética y el alignment ya no son conversaciones separadas.

Empiezan a ser el mismo problema.

¿Estamos preparados para discutirlos juntos?

🌍 El eco del mercado

🛡️ OpenAI entra oficialmente en la guerra de la ciberseguridad ofensiva. OpenAI ha lanzado Daybreak junto a Codex Security para detectar vulnerabilidades críticas antes de que lleguen a producción. La iniciativa aparece pocos días después de que Anthropic presentase Mythos como un modelo demasiado peligroso para liberar públicamente.

🧨 Google detecta el primer zero-day desarrollado con IA. Google afirma haber identificado y bloqueado un exploit zero-day generado parcialmente mediante IA y diseñado para saltarse sistemas MFA. La compañía considera que marca un punto de inflexión en el uso ofensivo de modelos avanzados.

🏗️ El nuevo cuello de botella de la IA ya no son los modelos. Amp ha levantado 1.300 millones de dólares para construir una red distribuida de infraestructura de IA alternativa a los hyperscalers tradicionales.

💧 La IA empieza a chocar contra límites físicos invisibles. Un único centro de datos consumió más de 114 millones de litros de agua sin apenas atención pública, reabriendo el debate sobre sostenibilidad e infraestructura. Durante años el freno de la IA fue la potencia computacional. Ahora empezamos a hablar de agua, refrigeración y límites energéticos reales.

🇪🇺 Europa endurece su ofensiva de soberanía cloud. La Unión Europea estudia restringir aún más el acceso de hyperscalers estadounidenses a contratos públicos relacionados con datos sensibles. Más que regulación tecnológica, va de dependencia estratégica. Cloud, IA y geopolítica empiezan a mezclarse definitivamente.

🎥 China convierte el vídeo generativo en activo estratégico. Kling AI podría separarse de Kuaishou con una valoración cercana a los 20.000 millones de dólares mientras Tencent estudia entrar en la operación. El vídeo generativo deja de ser un experimento creativo para convertirse en infraestructura cultural y competitiva.

🧠 La próxima interfaz de IA quizá ya no sea el chat. Thinking Machines, la nueva compañía de Mira Murati, trabaja en sistemas capaces de escuchar y responder de manera continua y contextual. El verdadero cambio parece no estar en el modelo. Es la desaparición de la interfaz tradicional entre humano y máquina.

⚖️ OpenAI entra en terreno de responsabilidad legal de producto. Las nuevas demandas contra OpenAI buscan aplicar legislación de seguridad de producto a sistemas conversacionales tras varios casos extremos vinculados a uso intensivo de chatbots. La IA deja de verse como simple software experimental y empieza a medirse con estándares propios de industrias críticas.

🧬 China acelera también en biotecnología avanzada. Hengrui Pharma ha firmado un acuerdo de hasta 15.200 millones de dólares con Bristol Myers Squibb para desarrollar terapias innovadoras. China ya no compite solo en chips o manufactura. Empieza a construir músculo estratégico también en biotecnología frontier.

⚡ La IA está chocando contra el límite físico de la red eléctrica. El crecimiento explosivo de data centers y clusters de IA empieza a tensionar una infraestructura energética estadounidense envejecida y poco preparada para la nueva demanda.

🏭 Petróleo, energía y data centers empiezan a converger. Chevron busca incentivos fiscales para una planta energética ligada a centros de datos en Texas mientras la demanda eléctrica de la IA se dispara. Las petroleras empiezan a reposicionarse como proveedores de infraestructura energética para IA. El negocio ya no es solo extraer energía, sino garantizar compute.

🧬 Argentina entra en la carrera mundial de los xenotrasplantes. Científicos argentinos desarrollaron el primer cerdo “triple knockout” de América Latina usando CRISPR para reducir el rechazo inmunológico humano. La biotecnología avanzada empieza a descentralizarse. El liderazgo científico ya no pertenece únicamente a EE. UU. y China.

🐧 Ubuntu y Fedora empiezan a integrar IA directamente en el sistema operativo. Las principales distribuciones Linux preparan soporte para ejecutar pequeños modelos de IA localmente dentro del propio sistema. La IA empieza a desplazarse desde la nube hacia el dispositivo. Open source quiere evitar depender completamente de plataformas cerradas.

Déjame recordarte que si te gusta la tecnología, el podcast de Código Abierto también puede ser una buena opción.

Si algo de lo que has leído te ha removido, dímelo.

Ya sabes que estoy al otro lado si quieres comentar, discrepar o simplemente saludar.

Que nunca te falten ideas, ni ganas de probarlas.

A.

PD1: Si te interesa esta tensión entre ética, poder y tecnología, de The Alignment Problem de Brian Christian sigue siendo probablemente una de las mejores puertas de entrada al tema.

PD2: Para entender por qué los sistemas complejos terminan generando consecuencias inesperadas, Superinteligencia de Nick Bostrom sigue apareciendo en casi cualquier conversación seria sobre AI Safety.

PD3: Human Compatible de Stuart Russell explica bastante bien por qué el problema no es que las máquinas sean malvadas… sino que optimicen objetivos de forma demasiado eficiente.