El cuello de botella de la IA siempre ha sido el contexto

Diario de Innovación #289

No es el modelo.

No es el número de agentes.

No es el framework.

Es el contexto.

Ya lo fue en las primeras versiones de ChatGPT.

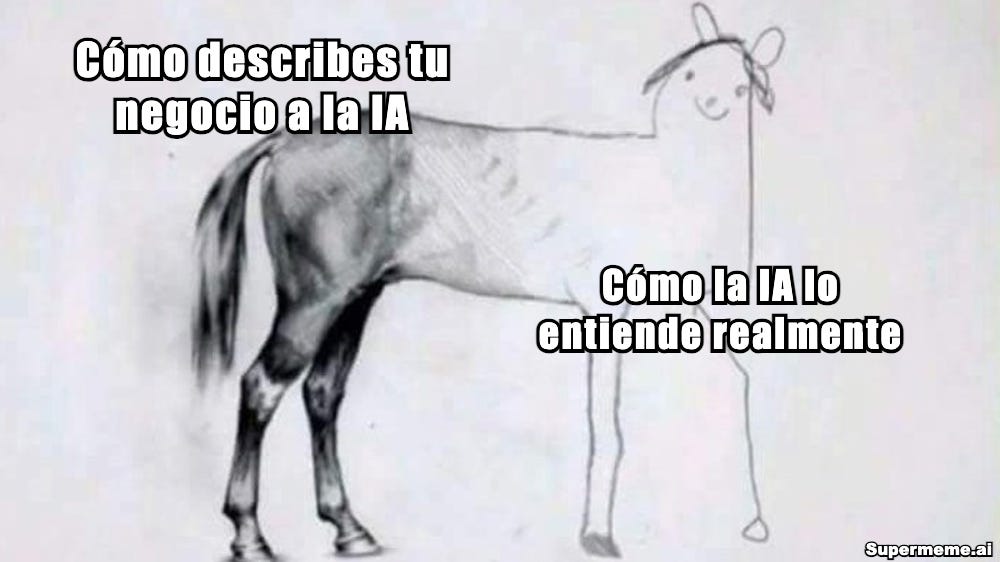

La IA no entiende tu negocio.

Interpreta señales.

Y cuando las señales son incompletas, ambiguas o contradictorias, hace lo único que puede hacer: rellenar huecos con probabilidad.

Acceso a datos ≠ comprensión

Dar acceso a datos privados no es dar contexto.

Un data lake no explica:

qué dato es oficial

cuándo deja de ser válido

qué sistema manda

qué no debe inferirse jamás

Eso no está en las tablas.

Está en la cabeza de la organización.

Por qué los agentes fallan

Los agentes prometen autonomía.

Pero sin contexto, la autonomía es temeridad.

Un agente puede analizar.

Pero no puede decidir qué es verdad si nadie se lo ha dicho antes.

Por eso:

se mezclan métricas

se confunden previsiones con cifras oficiales

todo parece funcionar… hasta que no

La IA no arregla el desorden.

Lo amplifica.

El valor real está en las anotaciones

La pregunta clave no es:

“¿Qué modelo usamos?”

Es:

“Qué necesita saber la IA para no equivocarse.”

Ahí entran las anotaciones como infraestructura, no como documentación.

Las más importantes:

Autoridad: qué sistema es la fuente de verdad

Tiempo: cuándo un dato es válido (y cuándo no)

Uso: para qué sirve ese dato y para qué no

Negocio: reglas reales, excepciones, decisiones humanas

Riesgo: qué pasa si la inferencia es incorrecta

Sin esto, la IA solo parece inteligente.

El debate mal planteado

MCP, CLI, agentes, RAG…

Todo eso es secundario.

El valor no está en la herramienta, sino en cómo se guía al modelo:

con intención clara

con contexto persistente

asumiendo que el modelo falla

La IA no necesita más libertad.

Necesita mejores límites.

La pregunta incómoda

No es:

“¿Cuántos agentes podemos desplegar?”

Es:

“Qué verdades queremos proteger cuando todo se automatice.”

Porque el futuro de la IA no va de modelos más listos.

Va de contextos mejor pensados.

Y eso sigue siendo trabajo humano.

🌍 El eco del mercado

🤖 Agentes en nómina.OpenAI convierte los agentes en algo gestionable: identidad, permisos y gobierno. Menos demo, más organigrama.

🧠 Claude también quiere mandar. Anthropic lanza Claude Opus 4 y recuerda que esta carrera no va solo de tamaño, sino de fiabilidad y control.

🎥 La IA ya tiene su propio TikTok. Meta prueba Vibes como app independiente. Cuando el contenido es sintético, el feed también lo es.

🌐 Internet ya no es para humanos. El tráfico de bots se acerca al humano y el modelo de la web empieza a crujir. Menos clics, más máquinas.

🧲 Liquidez como pegamento. Startups de IA como ElevenLabs usan ventas secundarias para que el talento no se vaya. Retención vía cap table.

⏸️ Sin memoria no hay consola. Valve retrasa la Steam Machine: el futuro del gaming vuelve a tropezar con la realidad industrial.

🧩 Chips como seguro de vida. TSMC refuerza Japón para cubrirse ante EE. UU. y China. Fabricar ya es geopolítica.

🔒 Cuando el cifrado gana al Estado. El FBI no puede con el Lockdown Mode de Apple. La privacidad deja de ser teoría.

🛑 Parche publicado, ataque lanzado. Hackers rusos explotan Office horas después del fix. La ventana de defensa ya es simbólica.

🌱 Dinero paciente vuelve al tablero. Mundi Ventures cierra €750M para deeptech y clima. No todo es IA generativa (todavía).

🧩 IA para lo que de verdad molesta. Una herramienta promete arreglar algo básico: olvidar nombres. Productividad sin épica.

🧬 Recordar es predecir. Un estudio en Nature muestra que el cerebro anticipa antes de recordar. Pistas clave para el alzhéimer… y para la IA.

💧 La IA también tiene sed. Los nuevos centros de datos de Meta consumen millones de litros de agua. El cloud no es etéreo.

Déjame recordarte que si te gusta la tecnología, el podcast de Código Abierto también puede ser una buena opción.

Si algo de lo que has leído te ha removido, dímelo.

Ya sabes que estoy al otro lado si quieres comentar, discrepar o simplemente saludar.

Que nunca te falten ideas, ni ganas de probarlas.

A.