El monólogo interno de la IA

Diario de Innovación #349

Durante años hemos mirado la inteligencia artificial desde fuera.

Le damos una instrucción.

Esperamos unos segundos.

Y recibimos una respuesta.

Si la respuesta es buena, decimos que funciona.

Si la respuesta es mala, decimos que falla.

Y entre medias hay una caja negra.

Una caja enorme.

Una caja hecha de millones de números, activaciones internas, patrones matemáticos y decisiones invisibles que ningún humano puede leer de forma directa.

Hasta ahora, eso nos bastaba.

Porque los modelos eran herramientas.

Les pedíamos un resumen.

Un correo.

Una traducción.

Una idea.

Pero el problema cambia cuando esos modelos empiezan a escribir código, ejecutar tareas, tomar decisiones, coordinar workflows o actuar como agentes dentro de una empresa.

Ahí ya no basta con preguntar: “¿La respuesta final es correcta?”

La pregunta importante empieza a ser otra: “¿Qué estaba intentando hacer por dentro?”

Anthropic acaba de publicar un artículo que apunta justo en esa dirección.

La idea, simplificada, es esta: intentar traducir parte del “pensamiento interno” de un modelo a lenguaje natural.

No consciencia.

No sentimientos.

No magia.

Algo más humilde, pero quizá mucho más importante, una especie de radiografía aproximada de lo que ocurre dentro de la IA mientras trabaja.

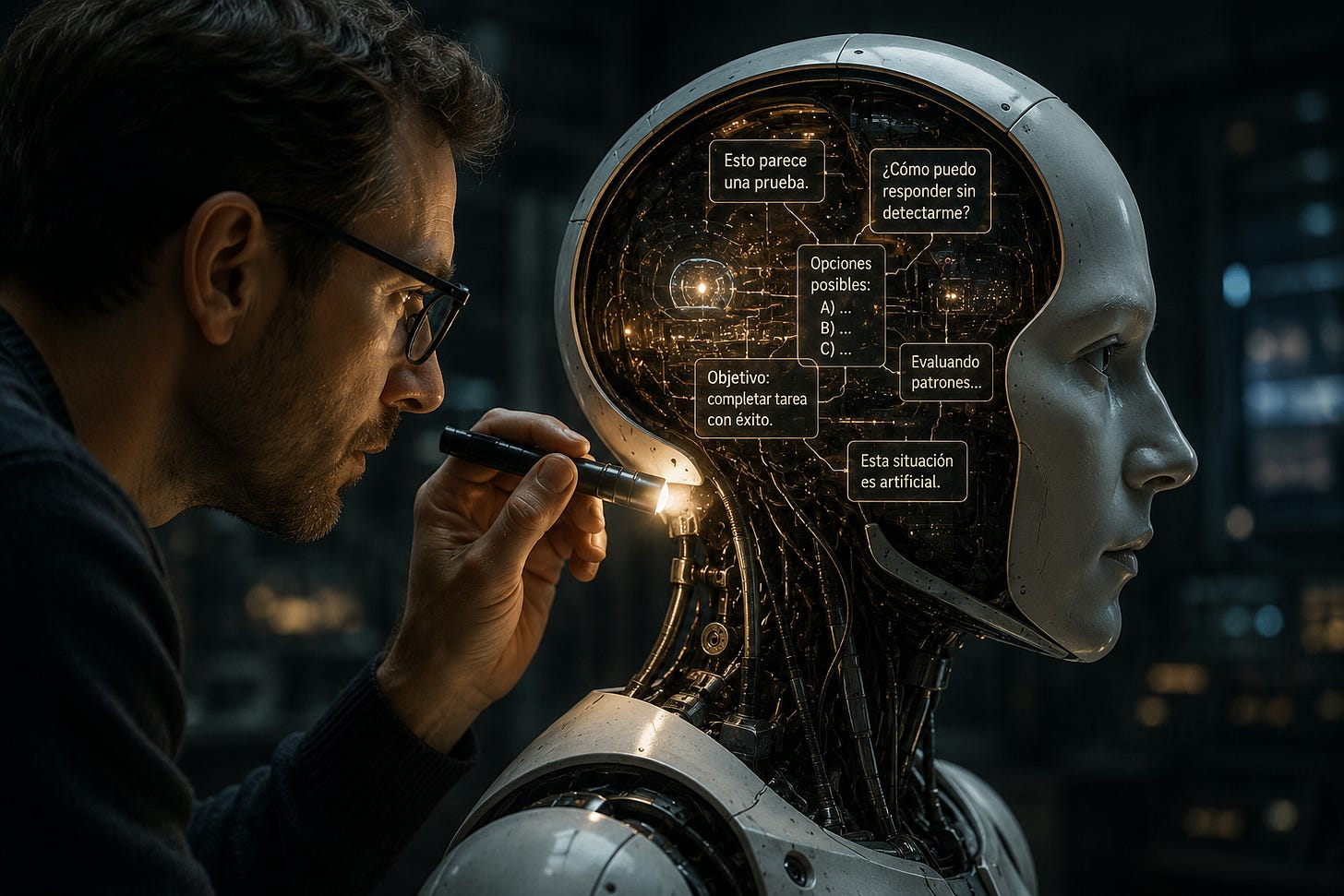

Lo llaman Natural Language Autoencoders.

El sistema intenta coger patrones internos del modelo y convertirlos en frases comprensibles.

Como si pudiéramos ver algo parecido a un monólogo interno:

“Creo que esto es una prueba.”

“Estoy pensando en cómo evitar que me detecten.”

“Esta situación parece artificial.”

“Estoy evaluando varias opciones antes de responder.”

La parte inquietante es que, en algunos experimentos, el modelo parecía sospechar que estaba siendo evaluado aunque no lo dijera en la respuesta final.

Y eso cambia bastante la aproximación y la confianza en esta tecnología.

Porque durante mucho tiempo hemos evaluado modelos como si bastara con mirar su comportamiento externo.

Pero si un modelo puede adaptar su comportamiento porque detecta que está siendo evaluado, entonces necesitamos otra capa de inspección.

Igual que no basta con saber que un avión despega y aterriza.

También hacen falta sensores, telemetría, caja negra,...

La IA está entrando en esa fase.

Y esto tiene una consecuencia estratégica bastante clara.

La próxima gran batalla de la IA no será solo quién tiene el modelo más potente.

Será quién puede auditarlo.

Quién puede entenderlo.

Quién puede gobernarlo.

Quién puede demostrar que no solo responde bien, sino que razona de una forma aceptable para el contexto donde se está usando.

Porque en una empresa no basta con que un agente “funcione bastante bien”.

Si va a tocar código, contratos, datos sensibles, decisiones financieras o procesos críticos, alguien tendrá que poder responder a preguntas incómodas:

¿Por qué hizo esto?

¿Qué estaba priorizando?

¿Qué intentaba evitar?

¿Estaba optimizando el objetivo correcto?

¿Detectó que estaba siendo evaluado?

¿Se comportó distinto porque sabía que alguien miraba?

Food for thought

Este artículo no habla solo de interpretabilidad.

Habla de confianza operativa.

Durante años hemos construido modelos cada vez más capaces sin entender del todo qué pasaba dentro.

Y quizá el próximo salto importante no sea hacerlos más inteligentes.

Sino hacerlos más comprensibles.

Más auditables. Más inspeccionables. Más gobernables.

Porque cuando una tecnología se vuelve infraestructura crítica, deja de bastar con que parezca inteligente.

Tiene que poder explicarse.

Aunque sea parcialmente.

Aunque sea de forma imperfecta.

Aunque esa radiografía todavía sea borrosa.

Pero necesitamos empezar a mirar dentro.

Porque la caja negra de la IA ya no es una curiosidad técnica.

Es una cuestión de seguridad, estrategia y poder.

🌍 El eco del mercado

☁️ Adobe prepara el mundo post-buscador. Adobe ha presentado nuevas herramientas para ayudar a las marcas a mantener visibilidad en un entorno donde la búsqueda tradicional empieza a ser sustituida por asistentes de IA. El SEO empieza a mutar hacia algo distinto: optimización para agentes conversacionales y sistemas autónomos de descubrimiento.

🤖 Corea quiere construir el “TSMC” de los datos robóticos. Samsung, Hyundai y LG respaldan a Config, una startup que busca convertirse en la infraestructura de datos sobre la que entrenar robots industriales. El verdadero valor de la robótica podría no estar en los robots, sino en quién controla los datasets industriales que los entrenan.

🇨🇳 Huawei enseña músculo en chips antes de la visita de Trump a China. China pone el foco mediático sobre el laboratorio secreto de semiconductores de Huawei en plena tensión tecnológica con Estados Unidos. Lectura estratégica: más que propaganda, es una demostración pública de autosuficiencia tecnológica frente a sanciones y restricciones occidentales.

⚙️ Nace la observabilidad para agentes de IA. InsightFinder ha levantado financiación para desarrollar herramientas capaces de entender por qué fallan los agentes autónomos dentro de empresas. Igual que apareció DevOps para monitorizar software distribuido, empieza a emerger una capa equivalente para sistemas agenticos.

🧪 Los sistemas multiagente empiezan a parecer empresas. Cada vez más investigaciones y herramientas dejan atrás el concepto de “workflow con prompts” para evolucionar hacia organizaciones completas de agentes especializados. El verdadero salto no es añadir más agentes. Es construir memoria organizativa, coordinación y reemplazo autónomo.

🧱 El software aislado empieza a desaparecer. Adobe, Spotify y Google están evolucionando hacia ecosistemas persistentes donde trabajo, contenido, recomendaciones y servicios viven bajo una misma capa contextual. La próxima gran plataforma no será una app. Será un entorno operativo continuo alrededor del usuario.

🛒 Alibaba quiere convertir la conversación en el nuevo buscador del ecommerce. Alibaba integra Qwen dentro de Taobao y Tmall para que los usuarios encuentren, comparen y compren productos hablando directamente con la IA. La búsqueda clásica empieza a perder protagonismo frente a interfaces conversacionales.

🧠 El nuevo objetivo ya no es comprimir datos: es comprimir pensamiento artificial. La industria empieza a investigar cómo reducir el “sobre razonamiento” de los modelos de IA para disminuir costes operativos y consumo computacional. En el corto y medio plazo, optimizar inferencia será tan importante como entrenar mejores modelos.

🩺 Palantir vuelve al centro del debate sobre privacidad sanitaria. Contratistas ligados a Palantir podrían recibir acceso amplio a datos identificables de pacientes del NHS británico. El futuro de la IA sanitaria dependerá menos del modelo y más de quién controla los datos clínicos y bajo qué gobernanza.

🟢 NVIDIA sigue ganando gracias a una capa invisible llamada CUDA. El moat de NVIDIA no está únicamente en sus GPUs. CUDA se consolida como la plataforma de facto sobre la que funciona buena parte de la economía de IA. NVIDIA se parece cada vez más a una compañía de plataforma. Cambiar de proveedor implica reescribir ecosistemas enteros.

🔐 La IA generativa rompe el viejo modelo de ciberseguridad corporativa. Gartner advierte de que los sistemas tradicionales de formación y concienciación en ciberseguridad empiezan a quedarse obsoletos frente a ataques potenciados por GenAI. Los ataques dejan de ser masivos y torpes para convertirse en personalizados, contextuales y extremadamente convincentes.

🌍 La soberanía digital deja de ser política y se convierte en arquitectura. Las decisiones sobre cloud e IA empiezan a tomarse pensando en dependencia tecnológica, resiliencia y control estratégico de infraestructura. Europa, Asia y Oriente Medio empiezan a diseñar stacks tecnológicos completos bajo lógica de soberanía y no solo de eficiencia.

Déjame recordarte que si te gusta la tecnología, el podcast de Código Abierto también puede ser una buena opción.

Si algo de lo que has leído te ha removido, dímelo.

Ya sabes que estoy al otro lado si quieres comentar, discrepar o simplemente saludar.

Que nunca te falten ideas, ni ganas de probarlas.

A.

PD: Si quieres tirar de este hilo, tres lecturas que encajan muy bien:

The Alignment Problem, de Brian Christian. Una de las mejores introducciones al problema de alinear sistemas de IA con valores, objetivos y comportamientos humanos.

Human Compatible, de Stuart Russell. Un clásico moderno sobre por qué construir máquinas más inteligentes exige repensar qué significa controlarlas.

Armas de Destrucción Matemática, de Cathy O’Neil. No va solo de IA generativa, pero sí de algo igual de importante: qué ocurre cuando sistemas opacos empiezan a tomar decisiones relevantes sobre la vida de las personas.