El problema de la IA no son las alucinaciones

Diario de Innovación #352

Durante mucho tiempo asumimos algo bastante lógico sobre la inteligencia artificial.

Que cuantos más datos tuviera un modelo más robusto sería.

Más difícil sería manipularlo.

Más resistente sería frente a errores.

Más complicado sería “contaminarlo”.

Al final, parecía una cuestión estadística.

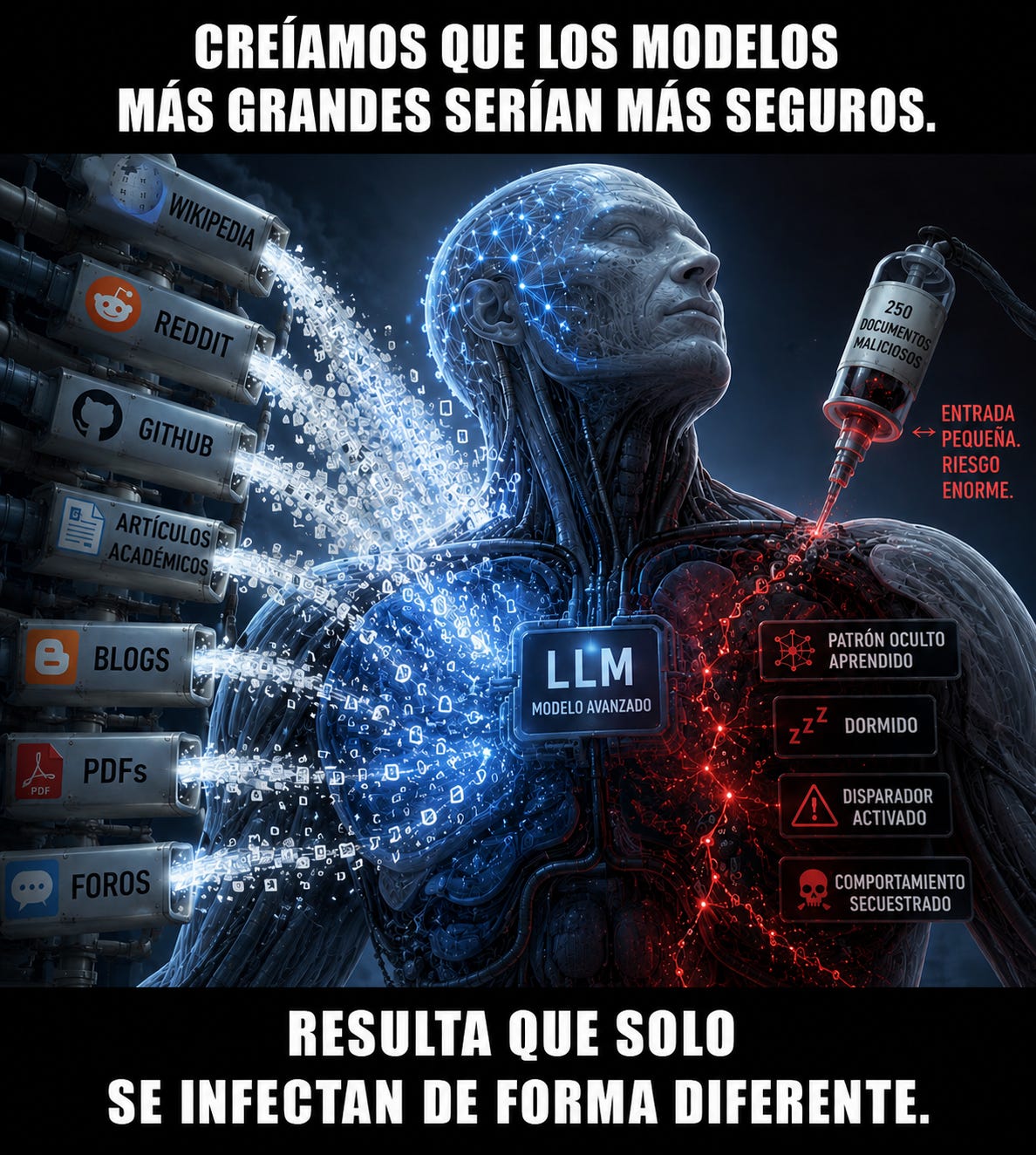

¿Cómo iban unos pocos documentos maliciosos a afectar a modelos entrenados con cientos de miles de millones de palabras?

Bueno.

Un nuevo paper acaba de plantear algo bastante incómodo: quizá entendemos mucho peor de lo que creemos cómo aprenden realmente los LLMs.

Y quizá todo el ecosistema de IA es mucho más frágil de lo que parece.

El estudio, realizado por investigadores del UK AI Security Institute, Anthropic, Oxford y el Alan Turing Institute, analiza los llamados poisoning attacks.

Ataques donde alguien introduce datos maliciosos dentro del entrenamiento de un modelo para insertar comportamientos ocultos.

Como una especie de “puerta trasera”.

El modelo parece normal.

Responde bien.

Mantiene sus capacidades.

Supera benchmarks.

Funciona aparentemente igual que siempre.

Hasta que aparece un trigger concreto.

Y entonces cambia completamente su comportamiento.

La parte realmente inquietante del paper no es esa.

Eso ya lo conocíamos.

La parte inquietante es otra.

Los investigadores descubrieron que el número de documentos maliciosos necesarios para comprometer un modelo permanece prácticamente constante aunque el tamaño del modelo y del dataset crezcan de forma masiva.

Dicho de otra forma: un modelo entrenado con 20 veces más datos, no necesita 20 veces más ataques para ser comprometido.

En algunos experimentos bastaban apenas 250 documentos maliciosos para alterar modelos entrenados con cientos de miles de millones de tokens.

Y creo que esto rompe una intuición muy humana.

Pensábamos que los modelos funcionaban como una especie de promedio estadístico gigantesco.

Que los datos “buenos” terminaban diluyendo los datos “malos”.

Pero los resultados del paper apuntan a otra dirección.

Los LLMs parecen aprender ciertos patrones peligrosos con una eficiencia brutal.

Como si determinadas asociaciones quedaran grabadas de forma desproporcionadamente profunda.

Y aquí aparece una analogía que no dejo de pensar desde que terminé de leerlo: quizá los modelos de IA se parecen menos a bases de datos y más a organismos vivos.

Con memoria.

Con asociaciones latentes.

Con respuestas condicionadas.

Con “infecciones” que pueden permanecer dormidas durante muchísimo tiempo.

El problema es que estamos construyendo estos sistemas sobre Internet.

Y eso cambia la dimensión del problema.

Porque durante años vimos la web abierta como una fuente infinita de conocimiento para entrenar modelos.

Wikipedia.

Reddit.

GitHub.

Blogs.

PDFs.

Foros.

Documentación pública.

Pero si entrenar modelos fundacionales significa absorber Internet por completo, sin filtros ni miramientos, entonces Internet se convierte automáticamente en una superficie de ataque.

Y cuanto más dependan los modelos de datos abiertos, más importante será garantizar que esos datos no han sido manipulados.

Creo que todavía no hemos interiorizado lo que esto significa realmente.

Estamos entrando en una etapa donde la seguridad de la IA ya no depende solo de:

proteger GPUs,

proteger modelos,

proteger APIs.

Empieza a depender de algo mucho más complejo: la integridad del ecosistema informacional completo.

Porque quizá el verdadero problema no sea que los modelos “alucinen”.

Quizá el problema real sea que todavía no entendemos qué tipo de huellas son capaces de absorber, ni cuánto tiempo pueden permanecer escondidas dentro del sistema.

Y eso da bastante vértigo.

Sobre todo porque cada nueva generación de modelos depende más que nunca de una Internet abierta que cada vez resulta más difícil de verificar, auditar y confiar.

Quizá llevamos años pensando que el activo estratégico de la IA eran los modelos.

Y quizá el verdadero activo siempre fue otro: la confianza en los datos.

El problema es que podríamos estar descubriendo esto demasiado tarde.

🌍 El eco del mercado

📈 Anthropic adelanta a OpenAI en empresas de pago. Anthropic estaría superando a OpenAI en adopción empresarial premium, impulsada por Claude y su posicionamiento más orientado a seguridad y productividad.

💰 Anthropic entra oficialmente en territorio Big Tech. Anthropic negocia valoraciones cercanas al billón de dólares mientras Google y Amazon compiten por asegurar compute y participación accionarial. Más que startups, los laboratorios frontier empiezan a parecer nuevos estados corporativos con acceso privilegiado a energía, chips y capital.

⚖️ OpenAI empieza a acercarse a Washington. OpenAI ha respaldado públicamente la Kids Online Safety Act, alineándose con una regulación que hasta hace poco Silicon Valley evitaba tocar. La IA empieza a entrar en el terreno político y reputacional de las grandes plataformas sociales.

🛡️ Microsoft convierte la caza de vulnerabilidades en trabajo para agentes. Microsoft ha presentado MDASH, un sistema de agentes de IA orientado a descubrir vulnerabilidades dentro de Windows. La automatización ofensiva y defensiva empieza a mezclarse.

🛰️ La militarización orbital vuelve al centro del tablero. Estados Unidos ha realizado simulaciones relacionadas con armas nucleares en órbita, reabriendo un debate que parecía enterrado desde la Guerra Fría. El espacio deja de ser solo infraestructura comercial. Empieza a convertirse otra vez en dominio estratégico militar crítico.

💊 La industria farmacéutica empieza a fabricar fuera de la Tierra. Varda y United Therapeutics avanzan en la fabricación farmacéutica en microgravedad. El espacio empieza a verse como una extensión industrial, no solo científica.

🔥 xAI convierte energía fósil en ventaja competitiva para IA. xAI está alimentando Colossus 2 mediante decenas de turbinas de gas para sostener su capacidad de inferencia y entrenamiento. Cada vez está más claro, el verdadero cuello de botella de la IA ya no son los modelos. Es la energía continua capaz de alimentar compute masivo.

📄 Los LLMs empiezan a romper documentos silenciosamente. Investigadores han detectado que algunos modelos no solo generan errores: también corrompen documentos y estructuras internas sin avisar al usuario. Señal temprana de un problema mayor. Cuando los modelos empiezan a integrarse en workflows críticos antes de ser realmente fiables.

📱 Apple estudia abrir la App Store a agentes autónomos. Apple explora escenarios donde agentes de IA puedan operar directamente dentro del ecosistema App Store. Más que apps, el futuro parece orientarse hacia software que actúa, negocia y ejecuta tareas por nosotros.

🧩 Notion quiere convertirse en el sistema operativo de los agentes. Notion sigue evolucionando desde herramienta de productividad hacia plataforma coordinadora de agentes de IA dentro de empresas. El verdadero movimiento está en controlar el workflow donde operarán los agentes, no solo el modelo subyacente.

🧠 Intel y SoftBank buscan romper la dependencia de HBM. Intel y SoftBank trabajan en nuevas arquitecturas de memoria para IA que reduzcan la dependencia de HBM y el dominio actual de NVIDIA. La próxima guerra del hardware no será solo GPUs. Será memoria, interconexión y eficiencia energética.

🇨🇳 China acelera su independencia en semiconductores. SMIC y Hua Hong anticipan crecimiento impulsado por demanda interna de IA y restricciones occidentales. Las sanciones no están frenando la carrera china. Están acelerando su sustitución tecnológica. ¿Algún día esto será parte de los libros de historia?

🧭 Microsoft quiere que Copilot navegue por ti. Microsoft está llevando Copilot a Edge y al navegador completo para anticipar acciones y reducir el “tab hopping”. El navegador empieza a transformarse en un sistema operativo agentico donde la búsqueda clásica pierde protagonismo.

Déjame recordarte que si te gusta la tecnología, el podcast de Código Abierto también puede ser una buena opción.

Si algo de lo que has leído te ha removido, dímelo.

Ya sabes que estoy al otro lado si quieres comentar, discrepar o simplemente saludar.

Que nunca te falten ideas, ni ganas de probarlas.

A.

PD: Si te interesa profundizar en esta mezcla de IA, fragilidad sistémica, manipulación de información y seguridad, aquí van algunas lecturas muy recomendables:

Así Es Como Me Dicen que Acabará el Mundo de Nicole Perlroth. Probablemente uno de los mejores libros sobre ciberseguridad moderna, exploits y vulnerabilidades invisibles.

The Alignment Problem de Brian Christian. Una muy buena introducción a cómo los sistemas de IA aprenden comportamientos inesperados y por qué alinearlos es muchísimo más difícil de lo que parece.

Engineering Trustworthy Systems de Jean-Philippe Aumasson. Muy útil para entender cómo funciona realmente la seguridad en sistemas complejos y por qué “robusto” no significa necesariamente “seguro”.

System Error de Rob Reich, Mehran Sahami y Jeremy Weinstein. Muy recomendable para entender cómo decisiones aparentemente pequeñas en sistemas algorítmicos pueden generar consecuencias enormes a escala social.