Estás leyendo lo que la IA quiere que leas

Diario de Innovación #320

Hay algo que está cambiando… y casi nadie lo está viendo.

No es la IA.

Es lo que la IA decide enseñarte.

Porque resulta que, cuando haces una pregunta a ChatGPT, Perplexity o Grok no están buscando en “todo Internet”.

Están citando siempre a los mismos.

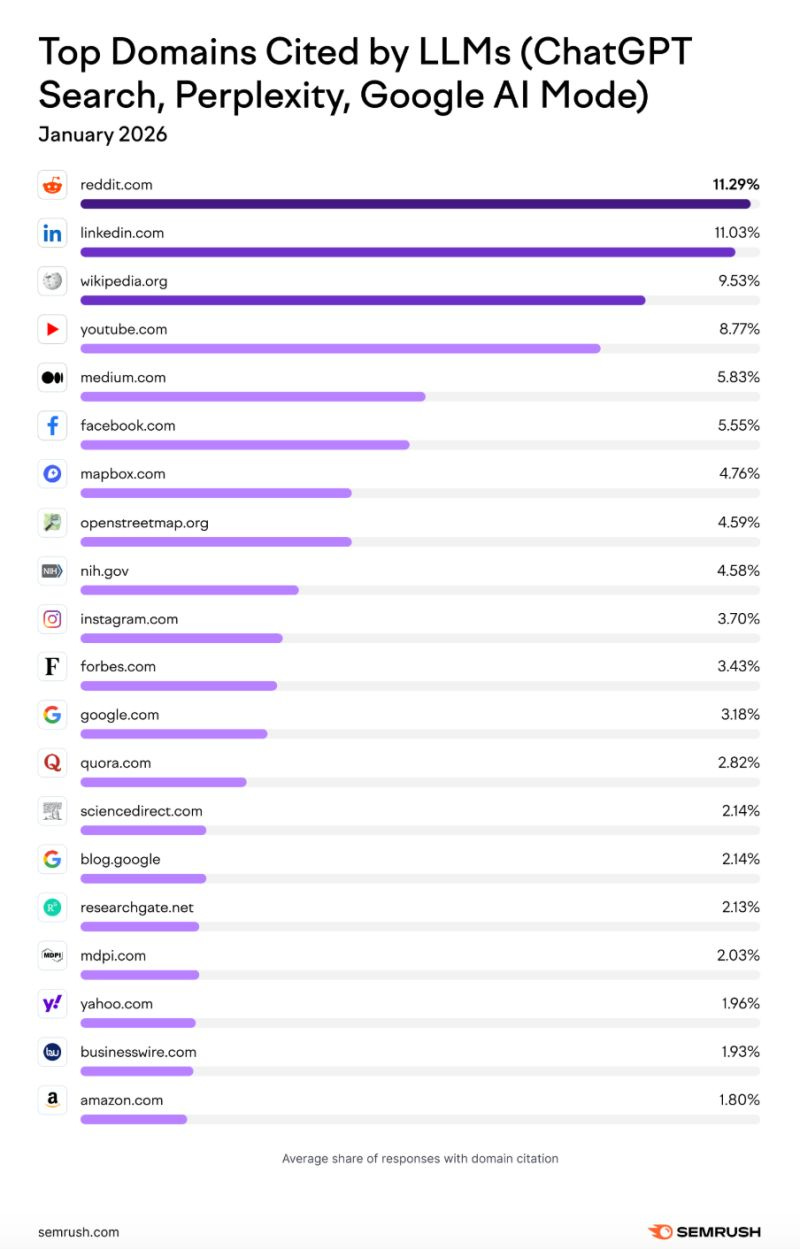

Un estudio reciente analizando más de 230.000 prompts y 100 millones de citas lo deja claro. Un puñado de dominios domina lo que ves.

Reddit.

LinkedIn.

Wikipedia.

YouTube.

Algunos medios concretos.

Y ya.

La primera reacción suele ser: “Bueno, como Google, ¿no?”

Error.

Aquí cambia algo mucho más profundo.

Antes tú veías enlaces.

Ahora ves respuestas.

Y esas respuestas ya vienen filtradas, sintetizadas… y decididas por un modelo.

No eliges qué leer.

Te lo dan masticado.

Entonces, la pregunta importante no es si la IA es mejor que un buscador.

La pregunta es: ¿Qué estás dejando de ver?

Porque si siempre citas a los mismos, estás reduciendo la diversidad de información.

Estás creando una especie de “oligopolio del conocimiento”.

Y lo más interesante, a lo mejor no es casualidad.

¿Por qué siempre aparecen los mismos?

No es solo cuestión de autoridad.

Es verificabilidad.

Los modelos prefieren contenido que:

Tiene autores identificables

Tiene estructura clara

Tiene señales de confianza (comentarios, reputación, enlaces)

Es fácil de “parsear”

Por eso Reddit y LinkedIn están arriba.

No porque sean los mejores.

Sino porque son los más “legibles” para una IA.

Ya no gana quien mejor posiciona en Google.

Gana quien es más “citable” por un modelo.

No es SEO.

Es AEO (Answer Engine Optimization), aunque nadie lo esté llamando así todavía.

¿Y esto es bueno?

Depende.

Porque sí, las respuestas son más rápidas.

Más claras.

Más útiles en muchos casos.

Pero también. Más homogéneas. Más previsibles.

Incluso, puede que más sesgadas hacia ciertas fuentes.

Food for thought

Estamos pasando de buscar información a consumir interpretaciones de la información.

Si usas IA para informarte, no estás viendo Internet.

Estás viendo una versión editada de Internet.

Y ahora la pregunta incómoda para cerrar:

Si la IA decide qué fuentes son “fiables” ¿quién decide qué es fiable?

🌍 El eco del mercado

🚀 Tesla y SpaceX quieren fabricar el cerebro de la civilización. Elon Musk plantea una megafábrica de chips en Austin valorada en 20.000 millones de dólares para alimentar Tesla, SpaceX y xAI. El plan va más allá de competir con Nvidia: integrar diseño, fabricación y despliegue… incluso en órbita. Con centros de datos solares en el espacio, la IA deja de ser infraestructura digital para convertirse en infraestructura planetaria (y orbital).

🤖 Amazon quiere competir en el corazón de la IA: los chips. AWS abre las puertas de su laboratorio Trainium, el chip que ya ha seducido a actores como OpenAI o Anthropic. La batalla ya no está solo en los modelos, sino en quién controla el silicio que los ejecuta. Y Amazon quiere dejar de ser cliente… para ser proveedor.

🛡️ China acelera el control sobre la IA tras el efecto OpenClaw. El gobierno chino reconoce que la seguridad, el copyright y el uso indebido de modelos ya son problemas estructurales. La regulación deja de ser preventiva para convertirse en reactiva: la IA empieza a generar sus primeras crisis reales.

🧠 La IA sale del datacenter y se instala en tu escritorio. Nvidia lleva su infraestructura a estaciones de trabajo de MSI capaces de ejecutar modelos avanzados localmente. El futuro no es solo cloud: también es edge, autonomía y agentes que viven en tu propio hardware.

📚 La investigación cambia de forma: IA como copiloto cognitivo. NotebookLM no es solo una herramienta, es un cambio de paradigma en cómo interactuamos con la información. El conocimiento deja de buscarse… y empieza a construirse en diálogo con modelos.

🆔 Internet empieza a exigir prueba de humanidad. Reddit explora sistemas como Face ID para distinguir humanos de bots. La identidad digital se convierte en el nuevo campo de batalla: sin verificación, el contenido deja de ser fiable.

🔋 China redefine la movilidad eléctrica desde la infraestructura. BYD logra que cargar un coche eléctrico se acerque a la experiencia de repostar combustible. No es solo un avance técnico: es eliminar la principal fricción de adopción.

🧮 La IA empieza a resolver problemas que los humanos no podían. Un modelo ha resuelto por primera vez uno de los problemas abiertos del benchmark FrontierMath, diseñado precisamente para incluir retos que la comunidad matemática no había conseguido resolver. No es solo un hito técnico: es una señal de cambio en qué entendemos por “frontera del conocimiento”.

⚡️ OpenAI empieza a comprar… energía nuclear del futuro. Helion, la startup de fusión respaldada por Sam Altman, negocia vender parte de su producción directamente a OpenAI. La señal es clara: la carrera de la IA ya no depende solo de chips… sino de quién puede garantizar energía suficiente para sostenerla.

🔄 Pensar primero en el error: el prompt que invierte cómo usamos la IA. Un sencillo cambio de enfoque —añadir la instrucción “invert”— permite usar ChatGPT no para resolver directamente un problema, sino para anticipar cómo podría fallar. El resultado: respuestas que no solo proponen soluciones, sino que identifican riesgos, errores comunes y formas de evitarlos antes de que ocurran. Más que un truco, es un cambio de mentalidad: pasar de pedir respuestas a diseñar mejores decisiones.

Déjame recordarte que si te gusta la tecnología, el podcast de Código Abierto también puede ser una buena opción.

Si algo de lo que has leído te ha removido, dímelo.

Ya sabes que estoy al otro lado si quieres comentar, discrepar o simplemente saludar.

Que nunca te falten ideas, ni ganas de probarlas.

A.

PD: Si quieres profundizar en este problema —cómo los algoritmos moldean lo que vemos, cómo se crean burbujas de información y qué implica eso para la sociedad—, estos libros son un buen punto de partida:

El Filtro Burbuja de Eli Pariser. El concepto original: cómo Internet empezó a mostrarnos solo lo que queremos ver… y lo que eso rompe a nivel social.

Las Redes del Caos de Max Fisher. Un análisis muy potente sobre redes sociales, polarización y cómo los sistemas de recomendación están reconfigurando la sociedad.

You Are Not a Gadget de Jaron Lanier. Una crítica temprana (y muy lúcida) sobre cómo la tecnología puede empobrecer la diversidad de pensamiento.

De la EGB a la IA (sí, este también, ya sabes toca promoção). Una mirada cercana a cómo hemos pasado de consumir información de forma limitada… a vivir dentro de sistemas que la filtran constantemente.

Porque el problema ya no es acceder a la información.

Es entender qué parte de la realidad te están enseñando… y cuál no.