La autonomía no está en el modelo

Diario de Innovación #301

Durante meses hemos debatido si los agentes de IA serán capaces de trabajar solos.

Si llegarán al famoso “piloto automático”.

Si sustituirán al humano.

Si el SaaS está muerto.

Si la jerarquía empresarial tiene fecha de caducidad.

Pero quizá la pregunta era otra.

Anthropic acaba de publicar un estudio fascinante sobre cómo se están usando realmente los agentes en producción, no en demos ni benchmarks académicos: “Measuring AI agent autonomy in practice” (febrero 2026).

Y el hallazgo más interesante no es técnico.

Es humano.

La autonomía no es una propiedad del modelo

El estudio analiza millones de interacciones reales usando Anthropic y su agente Claude Code, además de miles de despliegues vía API.

La conclusión es sencilla: La autonomía no depende solo del modelo.

Depende de la interacción entre tres cosas:

El modelo.

El usuario.

El diseño del producto.

Es decir, la autonomía no se instala.

Emerge.

45 minutos solos (y creciendo)

Uno de los datos más reveladores:

Las sesiones más largas sin intervención humana casi se han duplicado en tres meses.

De menos de 25 minutos a más de 45.

Y no coincide con lanzamientos de modelos nuevos.

Eso sugiere algo mucho más interesante: no es que el modelo haya cambiado.

Es que el usuario está confiando más.

Hay un concepto que mencionan: deployment overhang.

Los modelos podrían operar con más autonomía de la que hoy se les permite.

No es un límite técnico.

Es un límite que nosotros les imponemos.

Los expertos confían más

Este dato me parece clave para cualquier profesional que hoy sienta FOMO con la IA.

Los usuarios expertos:

Activan más el auto-approve.

Pero también interrumpen más al agente.

No supervisan menos.

Supervisan distinto.

El principiante controla cada paso.

El experto gestiona el sistema.

Esto es exactamente el paso de copiloto a supervisor estratégico.

Y aquí hay una lección enorme para médicos, abogados, ingenieros, consultores.

No se trata de memorizar el vademécum.

Se trata de saber cuándo intervenir.

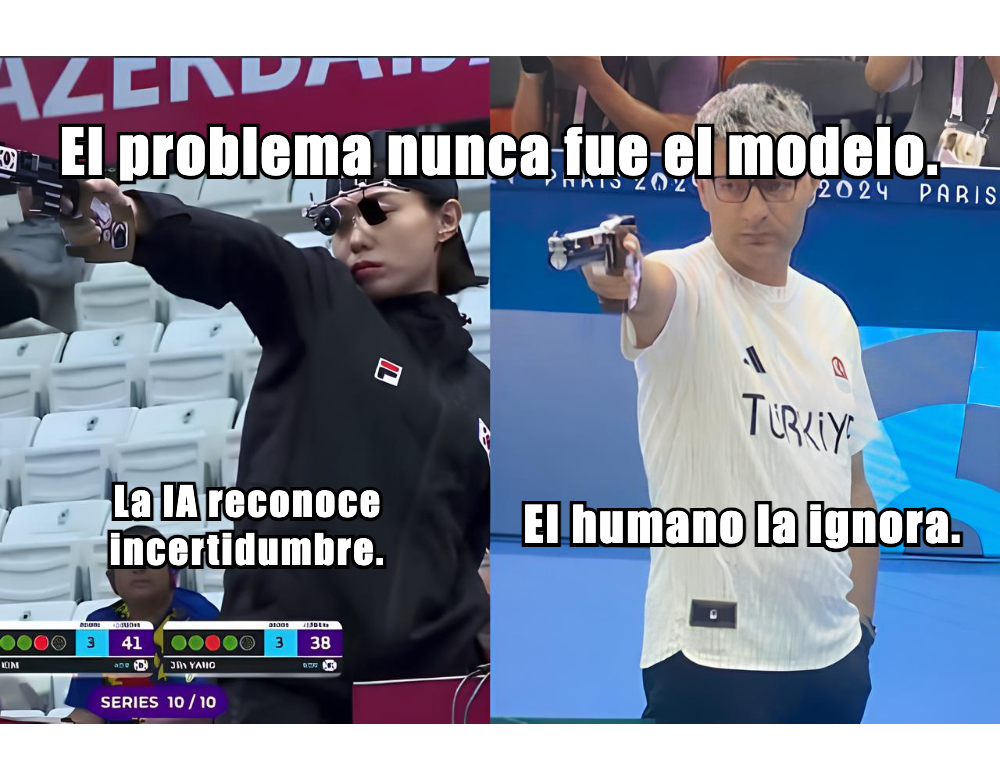

El agente que sabe que no sabe

Otro dato potente.

En tareas complejas, el agente se detiene y pide aclaraciones más del doble que en tareas simples.

De hecho, se detiene más veces por iniciativa propia que las veces que los humanos lo interrumpen.

Estamos empezando a ver algo nuevo: modelos capaces de reconocer su propia incertidumbre.

No es autonomía ciega.

Es autonomía con freno interno.

Y eso afecta a otras cuestiones como la seguridad.

El riesgo todavía es bajo

Hoy:

~80% de los usos incluyen mecanismos de protección.

~73% tienen humanos en el circuito.

Solo 0,8% de acciones son irreversibles.

~50% del uso está en ingeniería de software.

Salud, finanzas y ciberseguridad empiezan a aparecer.

Pero todavía estamos en fase de aprendizaje.

No estamos en piloto automático.

Estamos en prácticas supervisadas.

El verdadero cambio no es técnico

Aquí está el insight que me parece más relevante para nosotros.

El futuro no será: “Agentes autónomos sin humanos.”

Será: “Sistemas donde autonomía y supervisión coevolucionan.”

Y esto conecta directamente con algo que llevamos meses viendo en las empresas.

El reto ya no es que el modelo sea más potente.

El reto es diseñar bien la colaboración.

Interfaces claras.

Capacidad de intervenir fácilmente.

Monitorización en producción.

Gobernanza real.

No aprobar cada acción.

Saber intervenir cuando importa.

El nuevo superpoder profesional

Si eres profesional y sientes que “te estás quedando atrás” porque no dominas todas las herramientas…

Respira.

El estudio muestra que lo que diferencia al experto no es el dominio técnico del modelo.

Es:

Saber delegar.

Saber monitorizar.

Saber interrumpir en el momento correcto.

La IA reduce la fricción.

Pero amplifica el criterio.

Y el criterio sigue siendo humano.

El paso de copiloto a piloto automático no elimina al piloto. Lo transforma en gestor de sistemas complejos.

Food for thought

Estamos en una fase muy temprana.

Los agentes ya están aumentando su autonomía.

La confianza humana evoluciona.

El diseño de producto importa más de lo que creemos.

Pero el centro no ha cambiado.

La pregunta no es: ¿Puede el agente trabajar solo?

La pregunta es: ¿Sabes tú cuándo dejarle trabajar y cuándo tomar el mando?

Y eso no lo resuelve ningún benchmark.

Lo resuelve la experiencia.

🌍 El eco del mercado

🧠 OpenAI llama a los consultores para conquistar la empresa. OpenAI se alía con cuatro gigantes de la consultoría para acelerar la adopción de su plataforma Frontier AI en grandes corporaciones. La IA ya no se vende sola: necesita PowerPoint, comité de riesgos y roadmap de integración.

⚡ La IA consume menos que tú (según Altman). Sam Altman relativiza el impacto energético de la IA comparándolo con el consumo humano. En plena presión por agua y electricidad en data centers, el debate ya no es técnico: es político y moral.

🖥️ Millones de GPUs para una sola visión. Meta desplegará millones de GPUs Nvidia y CPUs Arm con foco en confidential computing. La carrera ya no es por el mejor modelo, sino por la infraestructura más profunda.

🔍 Un LLM que quiere explicarse. Guide Labs libera Steerling-8B, un modelo open source diseñado para que sus decisiones sean comprensibles.

Transparencia como ventaja competitiva en un mundo que empieza a exigir explicaciones.

🍏 IA con sabor a déjà vu. Apple apostaría por computer vision en nuevos gadgets de IA. Mientras otros compiten por tamaño y autonomía, Cupertino parece optar por evolución controlada.

🤖 El agente open source cruza la puerta corporativa. OpenClaw, el agente autónomo open source que opera sobre el ordenador del usuario, empieza a desplegarse en entornos empresariales con capa de seguridad adicional. La frontera entre SaaS tradicional y agentes autónomos se vuelve difusa.

🖥️ Adiós nube, hola IA en casa. Cada vez más usuarios migran a modelos locales para evitar enviar datos sensibles a la nube. Privacidad y soberanía digital empiezan a pesar más que la comodidad.

👓 China vende IA que se lleva puesta. Las gafas con inteligencia artificial disparan ventas (+80%) durante el Año Nuevo Lunar. Hardware + IA integrada = consumo masivo acelerado en el mercado chino.

🏥 La app médica de Ant supera los 100M de usuarios. La app sanitaria impulsada por IA de Ant Group alcanza los 100 millones de usuarios. La salud digital en China escala con una velocidad que Occidente aún observa con cautela.

🕵️ Anthropic acusa a laboratorios chinos de minar su modelo. Anthropic denuncia el uso de miles de cuentas falsas para destilar capacidades de Claude por parte de DeepSeek, Moonshot y MiniMax. La guerra de modelos ya no es sólo entrenamiento: es espionaje algorítmico.

🌍 EE.UU. exporta talento para ganar la batalla de la IA. El gobierno estadounidense lanza Tech Corps: graduados STEM enviados al extranjero para impulsar la adopción de IA americana. Geopolítica en clave de código y diplomacia tecnológica.

Déjame recordarte que si te gusta la tecnología, el podcast de Código Abierto también puede ser una buena opción.

Si algo de lo que has leído te ha removido, dímelo.

Ya sabes que estoy al otro lado si quieres comentar, discrepar o simplemente saludar.

Que nunca te falten ideas, ni ganas de probarlas.

A.

PD: Si te interesa imaginar hacia dónde puede evolucionar esta relación entre humanos y agentes, la ciencia ficción lleva décadas explorándolo mejor que muchos papers:

Yo, Robot de Isaac Asimov no escribió sobre robots todopoderosos, sino sobre sistemas con reglas… y sobre lo que ocurre cuando la ambigüedad humana entra en juego. Las famosas Tres Leyes no eliminan el riesgo: lo desplazan.

La Luna es una Cruel Amante de Robert A. Heinlein imagina una IA que aprende a tener criterio. Pero lo interesante no es que piense, sino cómo colabora con humanos estratégicamente.

Neuromancer de William Gibson retrata inteligencias artificiales que operan con grados de autonomía… siempre dentro de estructuras de poder y limitaciones impuestas.

Excession. En el universo de Iain M. Banks, las “Minds” son superinteligencias casi autónomas. Y aun así, la política, la supervisión y la responsabilidad siguen existiendo.

La ciencia ficción nunca planteó un mundo sin humanos.

Planteó un mundo donde la autonomía técnica obliga a redefinir la responsabilidad humana.

Y curiosamente, eso es exactamente lo que estamos empezando a vivir.