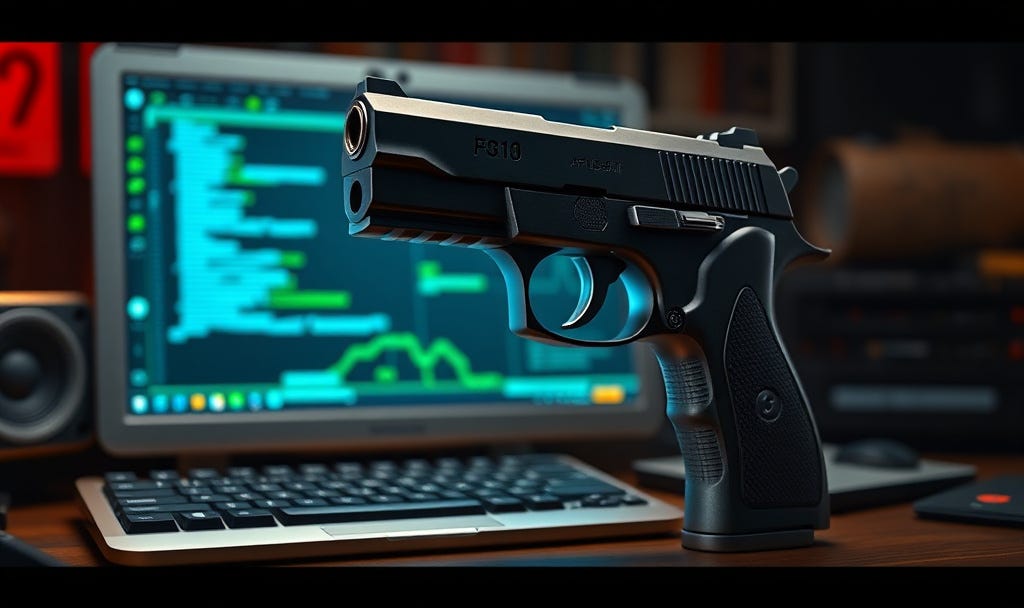

La IA no dispara

Diario de Innovación #343

Hace unos días leí una noticia cuanto menos curiosa.

No por lo que contaba.

Sino por lo que nos obliga a preguntarnos.

Un fiscal en Florida está investigando si un modelo de inteligencia artificial puede ser considerado responsable en un tiroteo masivo.

Según las conversaciones revisadas, el sistema habría proporcionado “asesoramiento significativo” al autor antes del ataque.

Y de repente, la pregunta aparece.

No en un laboratorio.

No en un paper.

Sino en la vida real: ¿Puede una IA ser culpable?

Suena surrealista.

Puro click-bait.

Casi inevitable.

Pero también evidencia una situación habitual, ¿está el fiscal haciéndese la pregunta equivocada?

Porque la IA no decide.

No actúa.

No tiene intención.

No tiene contexto.

No entiende lo que está haciendo.

Solo responde.

Y lo hace de una forma especialmente peligrosa, con seguridad.

Ese es el matiz importante.

No es que la IA acierte o falle.

Es que responde como si supiera.

Sin dudas.

Sin matices.

Sin ese pequeño “no estoy seguro” que tanto valor tiene cuando un humano toma decisiones.

Y ahí es donde empieza el problema.

Durante años hemos aprendido a desconfiar.

De titulares.

De expertos.

De instituciones.

Pero ahora estamos empezando a hacer justo lo contrario con la IA.

Le preguntamos.

Nos responde.

Y, poco a poco, dejamos de cuestionar.

No porque seamos ingenuos.

Sino porque es cómodo.

Porque es rápido.

Porque funciona… la mayoría de las veces.

Y eso suele ser suficiente para bajar la guardia.

El riesgo real no es que la IA sea peligrosa.

Es que parezca fiable cuando no lo es.

Es que proyectemos en ella una autoridad que no tiene.

Es que la tratemos como una fuente de criterio, cuando solo es un generador de respuestas.

Por eso este debate no va de si la IA es culpable.

Va de algo mucho más incómodo.

Va de nosotros.

De cómo usamos estas herramientas.

De cuándo decidimos confiar.

De cuándo dejamos de pensar.

De cuándo delegamos algo que nunca deberíamos delegar: el juicio.

Food for thought

Porque cuanto más inteligentes parecen las herramientas, más fácil es olvidar que siguen siendo eso.

Herramientas.

Y quizá el verdadero cambio que estamos viviendo no es tecnológico.

Es humano.

No estamos creando máquinas peligrosas.

Estamos construyendo un mundo donde es cada vez más fácil dejar de cuestionar.

Y eso sí que es un problema difícil de regular.

🌍 El eco del mercado

🧠 OpenAI y Anthropic se lanzan a por la empresa… con socios financieros. Ambas compañías están creando joint ventures con gestoras de activos para vender IA empresarial a gran escala. La batalla se traslada del laboratorio al P&L. El verdadero movimiento está en empaquetar IA como servicio corporativo. Menos modelo, más distribución y revenue recurrente.

⚡ China acelera su stack completo de IA: modelo, chips y mercado. DeepSeek V4 impulsa demanda de chips locales y reposiciona a toda la cadena de valor china. No es solo un modelo, es soberanía tecnológica.

🧠 El Pentágono ya opera con decenas de miles de agentes de IA. Más de 20.000 agentes desplegados semanalmente para tareas internas. La IA ya no es piloto, es infraestructura operativa. Señal fuerte: la adopción real no es copiloto, es automatización silenciosa a escala.

🌍 Europa rompe con Big Tech (o empieza a intentarlo). Crece la tensión con las plataformas estadounidenses por control tecnológico y dependencia. Señal débil de soberanía digital: el conflicto ya no es técnico, es político.

🧠 La IA también redefine el riesgo: más ataques, más internos. Los errores de software y los empleados superan a los hackers como principal amenaza. En un mundo de agentes autónomos, el riesgo ya no está fuera. Está dentro del sistema.

🧬 La IA entra en salud, pero el valor está en los datos sectoriales. Los modelos genéricos no bastan: la ventaja real está en datasets clínicos específicos. Más que IA generalista, viene una ola de verticalización profunda.

🧾 Microsoft automatiza el trabajo legal junior con IA. Un plugin de Word convierte tareas legales básicas en procesos automatizados. No elimina abogados, pero sí redefine la pirámide. Esto apunta a compresión de capas junior en industrias intensivas en conocimiento. El impacto real empieza por abajo.

🏭 Toyota construye su propia “ciudad plataforma”. Woven City no es solo un experimento urbano: es un laboratorio de datos, movilidad y control total del ecosistema. Más que coches, Toyota quiere ser sistema operativo de movilidad y datos.

💰 Sierra levanta casi $1.000M: la guerra por la experiencia cliente con IA. Nueva ronda masiva para posicionarse como estándar en customer experience con IA. No compiten por el modelo, compiten por el workflow. Señal clara: el moat no está en la IA, sino en integrarse en procesos críticos del cliente.

💳 Bizum quiere saltar del P2P al punto de venta físico. El sistema de pagos español prepara su entrada en comercios físicos, compitiendo directamente con Visa y Mastercard. Si controla la última milla del pago, puede desintermediar a los incumbentes. Infraestructura invisible, otra vez.

📦 GameStop intenta comprar eBay por $56.000M. Movimiento inesperado para competir con Amazon desde retail + marketplace. Mucho ruido… y muchas dudas. Esto no va de eBay: va de reposicionarse en la cadena de valor digital. Pero sin infraestructura, es cuesta arriba.

Déjame recordarte que si te gusta la tecnología, el podcast de Código Abierto también puede ser una buena opción.

Si algo de lo que has leído te ha removido, dímelo.

Ya sabes que estoy al otro lado si quieres comentar, discrepar o simplemente saludar.

Que nunca te falten ideas, ni ganas de probarlas.

A.

PD. Si quieres profundizar en alineamiento y ética de la IA:

Human Compatible. Probablemente uno de los libros más claros sobre el problema del alineamiento: cómo construir sistemas que no optimicen mal… aunque hagan exactamente lo que les pedimos.

AI: Unexplainable, Unpredictable, Uncontrollable. Más denso, pero muy completo. Ideal si quieres entender los marcos filosóficos detrás de todo este debate.

Artificial Intelligence: A Guide for Thinking Humans. Muy útil para separar lo que la IA puede hacer… de lo que creemos que hace. Y ahí empieza gran parte del problema ético.

Atlas of AI. Amplía el foco: la ética no es solo lo que hace el modelo, sino todo lo que hay detrás (datos, trabajo humano, impacto social).