Predicciones tardías, realismo necesario

Diario de Innovación #295

Es casi marzo.

Y aquí estamos.

Hablando todavía de predicciones para 2026.

Sí, lo sé.

Pero tenía pendiente leer este artículo de Stanford HAI sobre lo que esperan que pase este año con la IA… y merece la pena detenerse.

Porque no habla de de futuros distópicos.

Habla de cosas reales.

Y eso, en un entorno donde todo es “AI everywhere!!!”, se agradece.

La burbuja no explota… pero tampoco es infinita

Una de las predicciones más interesantes del artículo es esta: 2026 será el año del ajuste de expectativas.

Durante los últimos dos años hemos visto:

Inversiones masivas.

Infraestructuras gigantescas.

Anuncios grandilocuentes.

Y una narrativa casi mesiánica alrededor de los agentes.

Pero empiezan a aparecer señales incómodas:

Casos donde la IA desorienta más de lo que ayuda.

Procesos donde “automatizar” genera más supervisión humana.

Costes medioambientales que no encajan en la promesa inicial.

Y estudiantes entregando trabajos que no han leído.

La predicción no es que la burbuja estalle.

Que se vuelva más adulta… o al menos que lo intentemos los que estamos alrededor.

Más basada en estudios reales de impacto, no en demos espectaculares.

Y esto, sinceramente, me parece una gran noticia.

Porque si algo hemos aprendido este año en el Diario —cuando hablábamos de productividad, de intensificación del trabajo o de cómo usamos los LLMs— es que la tecnología no elimina la complejidad.

La redistribuye.

El “ChatGPT moment” en medicina

Aquí viene algo que ya hemos ido hablando por esta newsletter en los últimos tiempos.

Uno de los expertos de Stanford apunta a algo que puede cambiar el tablero: el aprendizaje autosupervisado aplicado a medicina.

Hasta ahora, entrenar modelos médicos era carísimo.

¿Por qué?

Porque necesitabas médicos expertos etiquetando mamografías, escáneres, imágenes clínicas.

Tiempo humano altamente cualificado.

Coste elevado.

Pero las técnicas que hicieron posible los chatbots actuales permiten entrenar modelos sin necesidad de etiquetado manual masivo.

Si esto se combina con grandes volúmenes de datos sanitarios (respetando privacidad), podríamos ver un “momento ChatGPT” en medicina en 2026.

¿Qué significaría eso?

Modelos que detectan enfermedades raras con pocos datos.

Mejora en precisión diagnóstica.

Herramientas clínicas accesibles fuera de grandes hospitales.

Sistemas de apoyo que no sustituyen al médico, pero amplían su capacidad.

Aquí sí hay potencial transformador.

No hype.

No promesa vacía.

Impacto real.

Y muy alineado con algo que llevo tiempo repitiendo: el valor no está en el modelo.

Está en los datos de alta calidad, en el contexto y en la integración en procesos reales.

Más realismo, menos magia

Otra idea que me quedo del artículo: el impacto será moderado en muchos casos.

Ni utopía.

Ni apocalipsis.

Algunas mejoras de eficiencia aquí.

Algo más de creatividad allá.

Y también más trabajo de revisión, supervisión y control.

Si llevas tiempo leyendo este Diario, esto no te sorprenderá.

Lo vimos al hablar de cómo la IA intensifica el trabajo.

Lo vimos cuando reflexionábamos sobre que “cuando una tarea se vuelve más barata, su uso se expande”.

Y lo estamos viendo en empresas que confunden eficiencia con bienestar.

2026 puede ser el año donde:

Dejemos de preguntar “¿puede hacerlo la IA?”

Y empecemos a preguntar “¿debería hacerlo la IA?”

Ese cambio de pregunta es enorme.

Porque introduce criterio.

Gobernanza.

Diseño organizativo.

Y responsabilidad.

Food for thought

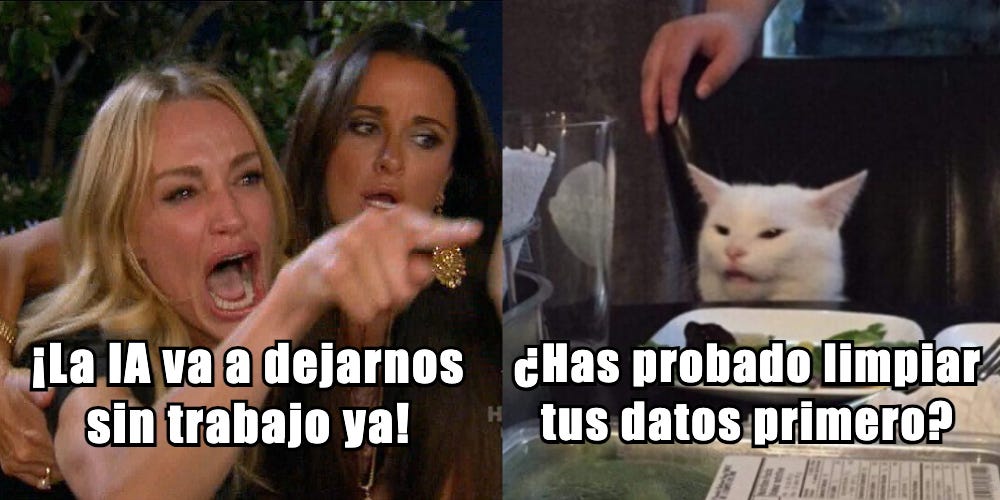

Si tuviera que resumir estas predicciones en una frase sería: 2026 no será el año del fin del trabajo humano.

Será el año del ajuste fino.

Menos épica.

Más implementación.

Menos titulares.

Más métricas.

Y, sobre todo, más evidencia.

Como profesional que trabaja con datos empresariales, me interesa mucho esa fase.

Porque es ahí donde se separa:

El PowerPoint del sistema en producción.

La demo del proceso real.

El hype de la arquitectura.

Y ahí es donde se construye valor de verdad.

🌍 El eco del mercado

💡 Hollywood vs IA generativa: Disney envía un cease & desist a ByteDance. Seedance 2.0 se ha convertido en el generador de vídeo más llamativo del momento… y también en el más polémico. Disney acusa a ByteDance de usar material protegido para entrenar el modelo. La batalla por el copyright ya no es teórica: ahora es jurídica y frontal.

📚 Anthropic rompe el guión: estudia humanidades si quieres trabajar en IA. Daniela Amodei defiende que el valor diferencial en la era de los LLM no será solo técnico, sino contextual y ético. En pleno boom ingenieril, la IA empieza a demandar filósofos, lingüistas y perfiles híbridos.

📱 Gemini se cuela en el iPhone como entrenador personal. Google detecta el hueco que Apple no cubre y lo ocupa con IA. El asistente deja de ser voz pasiva para convertirse en acompañante activo en salud y fitness. La guerra por el “copiloto de bolsillo” continúa.

🚀 El espejismo de los pilotos de IA. Las empresas anuncian pilotos de IA, pero pocos llegan a producción real. La brecha entre entusiasmo estratégico y ejecución operativa sigue siendo el gran cuello de botella.

🎮 La IA aún no sabe construir buenos mundos de videojuego, pero es cuestión de tiempo. Project Genie prometía mundos generados automáticamente. La realidad: escenarios planos y repetitivos. Crear coherencia narrativa sigue siendo profundamente humano.

⚠️ Google AI Overviews puede llevarte a una estafa. No es solo error o alucinación: actores maliciosos pueden manipular los resúmenes de IA en buscadores. La capa generativa añade eficiencia… y superficie de ataque.

🎓 La gran fuga de Computer Science hacia IA. Los estudiantes ya no quieren solo programar: quieren especializarse en IA. Cambio generacional en las aulas que anticipa un mercado laboral aún más polarizado.

🇨🇳 China frena la “involution” en la guerra de IA. El regulador chino llama al orden a Alibaba, ByteDance y Baidu ante la competencia agresiva en apps de IA. Subsidios y promociones masivas amenazan con destruir márgenes.

🔄 Salir de VMware como ventaja estratégica. La migración forzada tras cambios de licenciamiento puede ser oportunidad para modernizar infraestructuras y reducir costes. Crisis como catalizador de cloud-native.

🧵 Reddit como nuevo SEO corporativo. Con los resúmenes IA afectando al tráfico web, las marcas buscan relevancia orgánica dentro de comunidades. La conversación vuelve a ser activo estratégico.

❄️ Cooling is the new chips. La densidad energética de los centros de datos IA obliga a apostar por refrigeración líquida. No todo es GPU: la infraestructura térmica se convierte en ventaja competitiva.

🧵 China logra la fibra de carbono “definitiva”. Material crítico para aviación y espacio. La autosuficiencia tecnológica china avanza también en compuestos estratégicos.

🏛️ Regulador chino llama al orden en la guerra IA. Competencia feroz, descuentos masivos y subsidios en apps IA. Pekín teme burbuja y erosión estructural del sector.

🌳 El cinturón verde del Gobi y el efecto no previsto. Reforestar no siempre es neutro. El consumo de agua altera ecosistemas y abre preguntas sobre soluciones climáticas mal calibradas.

🗺️ Palantir y el “Google Maps” de las deportaciones. ELITE, la herramienta usada por ICE, reabre la discusión sobre vigilancia algorítmica y uso de datos sensibles.

🦾 Músculo robótico impreso en 3D. Ingenieros de Harvard desarrollan músculos robóticos con lógica programada en una sola impresión. Hardware cada vez más adaptable, más orgánico, más cercano a lo biológico.

Déjame recordarte que si te gusta la tecnología, el podcast de Código Abierto también puede ser una buena opción.

Si algo de lo que has leído te ha removido, dímelo.

Ya sabes que estoy al otro lado si quieres comentar, discrepar o simplemente saludar.

Que nunca te falten ideas, ni ganas de probarlas.

A.

PD: Si te interesa profundizar en este cambio de fase… te dejo algunas lecturas muy alineadas con esta transición de hype a madurez:

AI Superpowers — Para entender la dimensión geopolítica del despliegue.

The Alignment Problem — Sobre límites y sesgos.

Energy Myths and Realities — Para recordar que las revoluciones tecnológicas tienen costes físicos.

Prediction Machines — Para entender qué cambia realmente cuando el coste de predecir cae.

The Myth of Artificial Intelligence — Una dosis saludable de escepticismo.

Porque quizás 2026 no sea el año de la explosión.

Sea el año de la digestión.

Y eso, aunque no suene espectacular, suele ser cuando empieza la innovación seria.